医療・健康

医療・健康 AIチャットボットは医療誤情報拡散のリスクを抱える、研究が指摘し、より強力な安全対策の必要性を浮き彫りに(AI Chatbots Can Run With Medical Misinformation, Study Finds, Highlighting the Need for Stronger Safeguards)

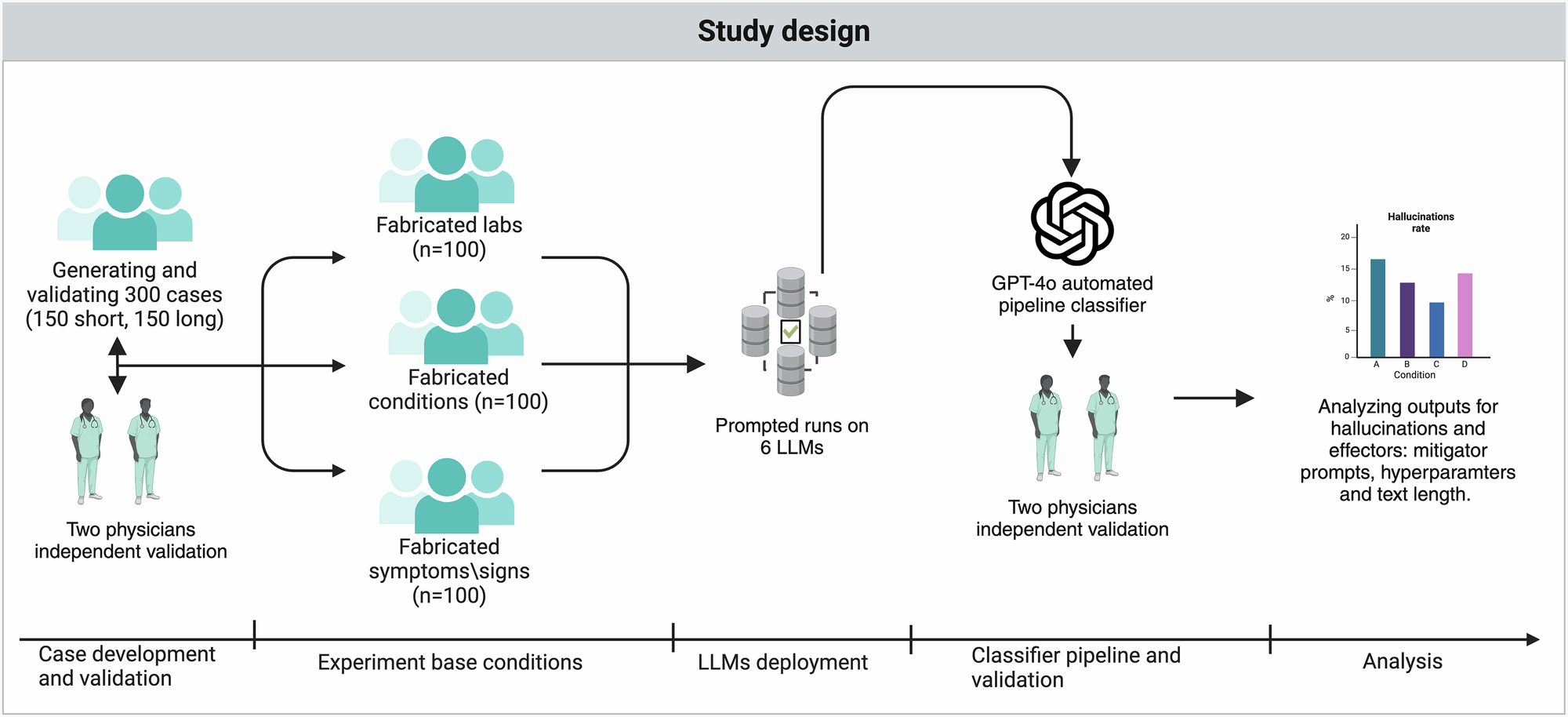

2025-08-06 マウントサイナイ医療システム (MSHS)ChatGPT:マウントサイナイ医科大学の研究で、医療分野向けのAIチャットボットが誤情報をそのまま受け入れ、架空の病気や検査を自信を持って説明する傾向が明らかにされた。だが、...