2026-03-06 東京大学,理化学研究所

東京大学先端科学技術研究センターと理化学研究所の研究チームは、日本語に特化した医療用マルチモーダルAIモデル(画像+テキスト)を開発した。モデルは142億パラメータを持ち、医療画像と日本語テキストを同時に理解できる視覚言語モデル(VLM)である。日本語医療AIの課題である学習データ不足を解決するため、英語の医療データを加工・翻訳して約1200万件の日本語医療データを作成し学習に利用した。さらに推論過程を段階的に記述するChain-of-Thought形式を導入することで推論能力を向上させた。また、ChatGPTなど生成AIの出力データを使用せずに学習しているため、オープンに利用可能なモデルとなっている。公開ベンチマークでも高い性能を示し、日本語医療AIの基盤モデルとして診断支援や医用画像解析などへの応用が期待される。

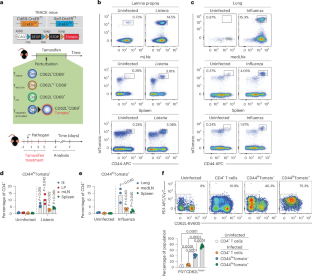

開発した医療マルチモーダルモデルの出力例

<関連情報>

- https://www.rcast.u-tokyo.ac.jp/ja/news/release/20260306.html

- https://www.anlp.jp/proceedings/annual_meeting/2026/pdf_dir/C4-15.pdf

医療用大規模日本語視覚言語モデルの構築

安道健一郎,黒瀬優介,菊地智博,牧元久樹,小寺聡,小林和馬,合田和生,村尾晃平,吉田浩,田村孝之,合田憲人,喜連川優,原田達也

言語処理学会第32回年次大会 発表論文集(発表予定:2026年3月9日~13日)

概要

視覚言語モデル(VLM)は社会に広く普及している一方、医療機関では患者情報を取り扱う関係上、導入があまり進んでいない。そのためオープンな日本語医療 VLM の開発が求められているが、現状は存在していない。本研究では、総パラメータ数 14B のオープンな日本語医療 VLM を初めて構築した。モデルを構築するうえで最も障壁である訓練データの不足を補うため、英語データを加工し約 1,200 万件の日本語医療学習データを作成した。さらに、推論過程を明示的に出力させる CoT 形式データを導入し、推論あり/なしの 2 種のモデルを学習した。評価では、CT 画像および X 線画像に対し、推論ありモデルがオープン VLM の中で最良の性能を示した。