神経科学者が脳波記録から歌を解読し、リズムとボーカルを扱う領域を明らかにした。 Neuroscientists decode song from brain recordings, revealing areas dealing with rhythm and vocals

2023-08-15 カリフォルニア大学バークレー校(UCB)

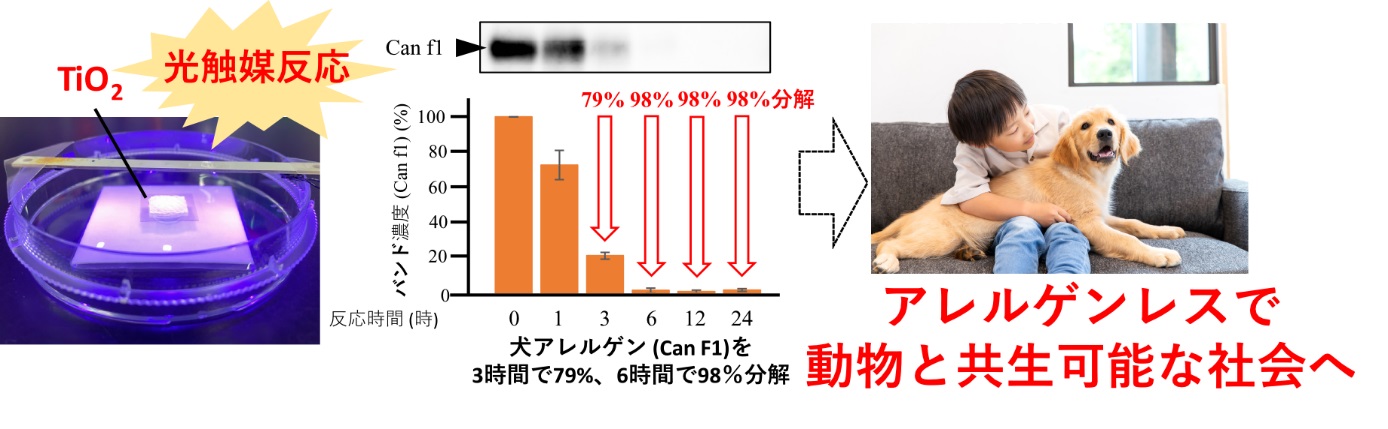

◆てんかん手術前の患者の脳に電極を装着し、音楽の音、リズム、ハーモニー、単語に反応する脳領域の電気活動を記録しました。29人の患者のデータを分析し、初めて脳の記録から認識可能な曲を再現することに成功しました。

◆この結果は、コミュニケーション障害を持つ人々のために音楽性のあるスピーチを再現する可能性を示し、人間のコミュニケーションにおける音楽の重要性を強調しています。

<関連情報>

- https://news.berkeley.edu/2023/08/15/releases-20230811

- https://journals.plos.org/plosbiology/article?id=10.1371/journal.pbio.3002176

非線形デコーディングモデルを用いて人間の聴覚野の活動から音楽を再構成することができる Music can be reconstructed from human auditory cortex activity using nonlinear decoding models

Ludovic Bellier ,,Anaïs Llorens,,Déborah Marciano,,Aysegul Gunduz,,Gerwin Schalk,,Peter Brunner,,Robert T. Knight

PLOS Biology Published: August 15, 2023

DOI:https://doi.org/10.1371/journal.pbio.3002176

Abstract

Music is core to human experience, yet the precise neural dynamics underlying music perception remain unknown. We analyzed a unique intracranial electroencephalography (iEEG) dataset of 29 patients who listened to a Pink Floyd song and applied a stimulus reconstruction approach previously used in the speech domain. We successfully reconstructed a recognizable song from direct neural recordings and quantified the impact of different factors on decoding accuracy. Combining encoding and decoding analyses, we found a right-hemisphere dominance for music perception with a primary role of the superior temporal gyrus (STG), evidenced a new STG subregion tuned to musical rhythm, and defined an anterior–posterior STG organization exhibiting sustained and onset responses to musical elements. Our findings show the feasibility of applying predictive modeling on short datasets acquired in single patients, paving the way for adding musical elements to brain–computer interface (BCI) applications.